微软亚洲研究院的数学与人工智能研究团队近日宣布了一项针对小语言模型在数学问题解决上的新突破,名为rStar-Math的技术正式亮相。

与微软先前推出的Phi-4技术有所不同,rStar-Math采用了蒙特卡洛树搜索(Monte Carlo Tree Search)的推理方法。这种方法模仿了人类解决问题的步骤,通过逐步分解复杂问题,从而找到解决方案。这种思维方式不仅使模型在处理数学问题时更具逻辑性,也提高了其解决问题的能力。

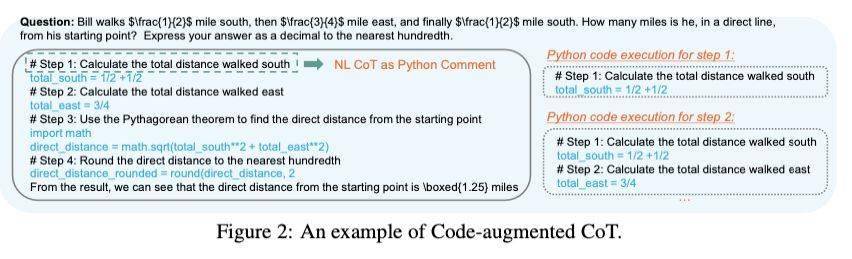

在rStar-Math的研发过程中,研究人员要求模型在生成答案时,不仅提供Python代码,还要以自然语言描述解题的“思维链”步骤。这种设计使得Python代码与自然语言描述相辅相成,自然语言成为代码的注释,有助于模型更清晰地理解并展示解题过程。同时,模型仅通过Python代码进行训练,进一步增强了其代码生成能力。

研究团队开发了两个关键模型:一个“策略模型”用于生成数学推理步骤,另一个“过程偏好模型”(PPM)则用于筛选最优解题步骤。这两个模型通过四轮“自我进化”过程,相互促进,不断提升性能。在训练过程中,团队使用了74万道公开的数学应用题及其解答作为初始数据,并通过这两个模型生成了新的解题步骤,进一步丰富了训练数据集。

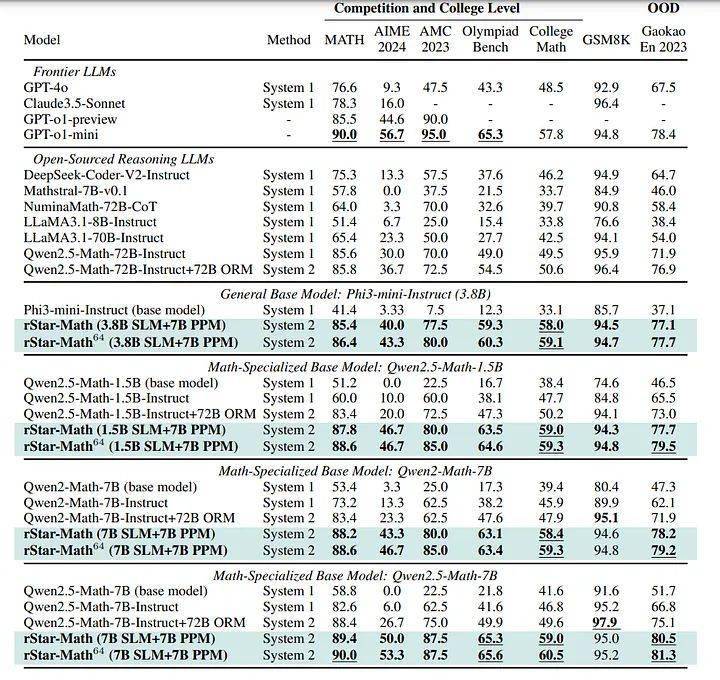

测试结果显示,rStar-Math技术的引入显著提高了数学模型的准确率。具体而言,Qwen2.5-Math-7B模型在应用rStar-Math后,准确率从58.8%大幅提升至90.0%;而Phi3-mini-3.8B模型的准确率则从41.4%跃升至86.4%。与OpenAI的o1-preview模型相比,这两个模型分别高出4.5%和0.9%。

为了让更多研究者能够利用并改进rStar-Math技术,微软亚洲研究院的研究团队宣布计划在GitHub上公开该技术的代码和数据。这一举措将有助于推动数学问题解决技术的发展,促进人工智能领域的研究与应用。