9月24日消息,智谱AI推出数学模型MathGLM,以提升大语言模型的数学推理能力。它可以在不使用计算器工具的情况下,高效执行复杂算术运算,解答中文数学应用题,部分表现超过GPT4和ChatGPT,目前已在魔搭社区ModelScope全球首发上架。

过往研究认为,大语言模型并不能精确执行高位数的算数运算,尤其是涉及超过8位数的乘法运算以及涉及小数、分数的运算。但MathGLM的出现,足以打破这些偏见。

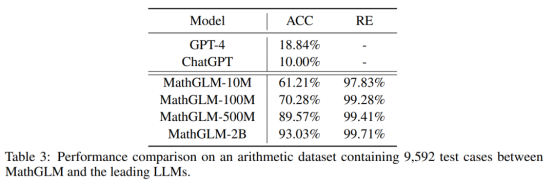

MathGLM包含10M、100M、500M、2B等多个参数版本,具备处理最多12位数字的运算能力。而且有测评结果显示,通过充分的数据训练,MathGLM-2B可以准确执行多位数的算术运算,准确率高达93.03%(接近100%),显著超越GPT-4在相同测试数据上18.84%的准确率。10亿参数版本的MathGLM-10B则在5000条中文数学应用题的测试数据集上实现了接近GPT-4的性能。

MathGLM出色的表现,离不开其在模型架构、数据集等方面的一系列创新。

针对算术任务,研发团队采用Transformer的decoder架构,并使用自回归目标在生成的算术数据集上从头训练。算术训练数据集包含各类算术任务、各种运算符(含加法、减法、乘法、除法和求幂)、多种数字格式(含整数、小数、百分比、分数和负数)。研发团队还采用分步计算策略对该数据集进行了重构,并且让单个算术表达式由 2 到 10 个运算步骤组成,以方便MathGLM对每个中间结果进行准确计算,从而得到每个算术表达式的正确答案。

评测结果显示,MathGLM在一个包含9592条测试用例、专门为算术任务量身定制的数据集上的表现,显著优于GPT4和ChatGPT。

针对更复杂的数学问题——中文应用题,研发团队微调了一系列以GLM为基座模型、用于解决数学应用题的MathGLM。

训练过程中使用了一个包含21万道中文小学数学题的高质量数据集Ape210K,但其不足之处在于每个题的答案都是直接计算得出,缺乏相应的计算过程。因此,研发团队采用分步策略对Ape210K数据集进行了重构,方便MathGLM深入理解和学习潜在的计算逻辑和规则,逐步计算出每个数学问题的答案,提升最终答案的准确性。

此外,研发团队还使用 ChatGLM-6B 和 ChatGLM2-6B 作为基座模型来训练 MathGLM,赋予 MathGLM 基本的语言理解能力,使其能够有效理解数学应用题中包含的语言信息。

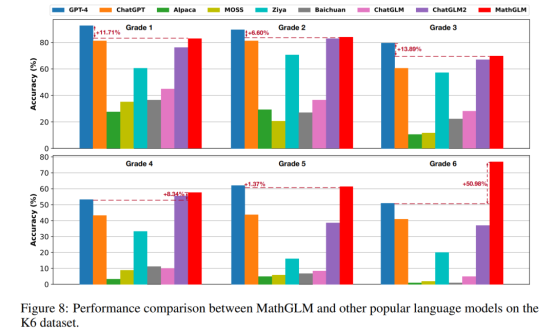

在Ape210K数据集上进行测试的结果显示,MathGLM模型在答案准确性方面已接近GPT-4。在一个包含1-6年级数学应用题的数据集K6上进行评测的结果显示,MathGLM相比于其他中文模型(GPT-4、ChatGPT、Chinese-Alpaca-13B、MOSS-16B、Ziya-LLaMA-13B、Baichuan-7B等),呈现出了更强的数学推理能力。

为方便开发者快速上手体验MathGLM,魔搭社区第一时间推出了模型体验、推理实践教程。

阿里云魔搭社区是国内规模最大、开发者最活跃的AI模型社区,拥有200多万开发者,聚集了20多家头部人工智能机构贡献的1000多款优质AI模型,为开发者提供一站式的模型体验、下载、推理、调优、定制等服务,社区模型累计下载量已突破7500万次。“找大模型,上魔搭”正在成为开发者的共识。

附:

MathGLM模型地址:

https://modelscope.cn/models/ZhipuAI/MathGLM/summary

魔搭创空间MathGLM模型体验链接:

https://www.modelscope.cn/studios/ZhipuAI/MathGLM-demo/summary

魔搭教程链接:

https://mp.weixin.qq.com/s?__biz=MzkxNTM5NTg2OA==&mid=2247486650&idx=1&sn=b1a729a720947a56a27d64dac1182519&chksm=c15e88c9f62901df978105f8ad084a72e651fbb97a7768b4159ecec751120c9772b795a41524#rd